이 시리즈의 첫 번째 블로그에서는 LLM 학습의 과제를 다루었습니다. 두 번째 블로그에서는 AI에 투자하는 기업을 위한 LLM 소비 모델(메이커, 테이커, 셰이퍼, RAG)에 대해 살펴봤습니다. 해당 3편 에서는 AI 애플리케이션의 구축 모델과 각 모델에 대한 비용 고려 사항을 살펴봅니다.

AI의 도입으로 AI 데이터센터의 성장과 투자가 크게 증가하고 있습니다. 거의 전적으로 클라우드 프로바이더 의존하던 기업들은 이제 프라이빗 데이터센터로 AI 데이터센터 공간을 확장하여 AI 워크로드 및 애플리케이션을 더 잘 제어하고 있습니다.

AI 데이터센터 투자 최대한 활용하기

IDC 에 따르면 AI 데이터센터 스위칭 장비에 대한 기업 투자는 2027년까지 연평균 성장률 158%를 기록하며 10억 달러 규모로 증가할 것으로 전망됩니다. 같은 기간 동안 클라우드 프로바이더 스위칭 성장은 91.5%의 높은 연평균 성장률을 이어갈 것으로 예상되지만, 일부 기업은 하이브리드 클라우드 전략을 도입하기 위해 학습 및 추론 워크로드의 일부를 프라이빗 데이터센터로 이전할 계획입니다.

대부분의 기업은 GenAI로 의미 있는 결과를 얻으려면 모델에 자체 기업 데이터를 사용해야 한다는 사실을 깨닫고 있습니다. AI를 통한 디지털 트랜스포메이션은 직원들에게 업무에 퍼블릭 LLM을 사용하도록 의무화하는 것보다 어렵습니다.

빌드 vs 구매: 이것이 문제로다

자체 프라이빗 데이터센터를 빌드할지, 퍼블릭 클라우드 프로바이더로부터 AI 서비스를 구매할지, 아니면 하이브리드 클라우드 모델을 결합하여 사용할지 결정하는 것은 몇 가지 중요한 고려 사항으로 귀결됩니다.

- 데이터 민감성(Data Sensitivity): 프라이빗 클라우드에 로컬로 유지해야 하거나 데이터가 지리적 경계로 제한되는 데이터 주권 규칙의 적용을 받는 민감한 데이터 또는 독점 데이터를 다루고 계신가요? 기술, 금융, 정부, 의료 사용 사례는 지적 재산을 보호하거나 소송의 불확실성을 피하기 위해 프라이빗 데이터센터를 필요로 할 가능성이 높습니다.

- 전문성: 사내 데이터 사이언스 또는 네트워킹 전문 지식은 어느 정도 수준인가요? 적절한 인력이 있다면 프라이빗 데이터센터를 구축하는 것도 좋은 선택입니다. 그렇지 않다면 전문성을 개발하거나 아웃소싱해야 합니다.

- 지역: 원하는 위치에 데이터센터 요구 사항을 지원할 수 있는 적절한 시설을 갖추고 있나요? GPU당 700W를 소비하는 대규모 학습 클러스터는 기존 시설에 많은 비용이 드는 전력 업그레이드가 필요할 수 있습니다. 또는 기업은 전력 예산 범위 내에서 유지하기 위해 여러 데이터센터 위치에 AI 클러스터를 분산할 수도 있습니다. RAG를 비롯한 추론 성능 때문에 소규모 AI 클러스터가 물리적으로 사용자와 훨씬 더 가까운 엣지 쪽으로 AI 데이터센터를 배치해야 할 수 있습니다. 제조 현장에 구축된 IoT 애플리케이션을 예로 들 수 있습니다. 하이브리드 아키텍처를 통해 기업은 학습, 추론, RAG를 위한 AI 기능을 최적화된 위치에 배치하기 위해 필요한 곳에 구축하고 필요한 곳에서 구매할 수 있습니다.

- 출시 시간: 출시 시간에 대한 압박이 어느 정도인가요? 즉시 출시가 필요한 경우 퍼블릭 클라우드 서비스를 이용하면 출시 시간을 단축하여 프라이빗 데이터센터 구축을 적절히 계획할 수 있는 귀중한 시간을 확보할 수 있습니다. 귀사의 AI 전환 여정은 어디까지 진행되었나요? 아직 시작 단계이고 비즈니스에 어떤 것이 효과적인지 알아보기 위해 많은 실험이 필요하신가요? 그렇다면 퍼블릭 클라우드를 사용하십시오. 그러나 AI에 전념하고 있고 비즈니스의 여러 부분에서 AI를 사용하는 방법에 대한 계획이 있다면 일반적으로 경제성 분석에 따라 프라이빗 클라우드 인프라에 투자하는 것이 좋습니다.

- 기업 전략: 많은 클라우드 전환 프로젝트와 마찬가지로, AI 이니셔티브는 부서 수준에서 시작하여 특정 고객 또는 운영상의 문제를 해결하기 위한 AI 클러스터를 만드는 경우가 많습니다. 기업이 보다 통합되고 공유된 AI 인프라를 통해 중요한 기업 전략을 개발함에 따라, AI 투자 비용을 보다 효율적으로 상각할 수 있어 프라이빗 데이터센터 AI 투자를 기존 기업 예산에 맞출 수 있습니다.

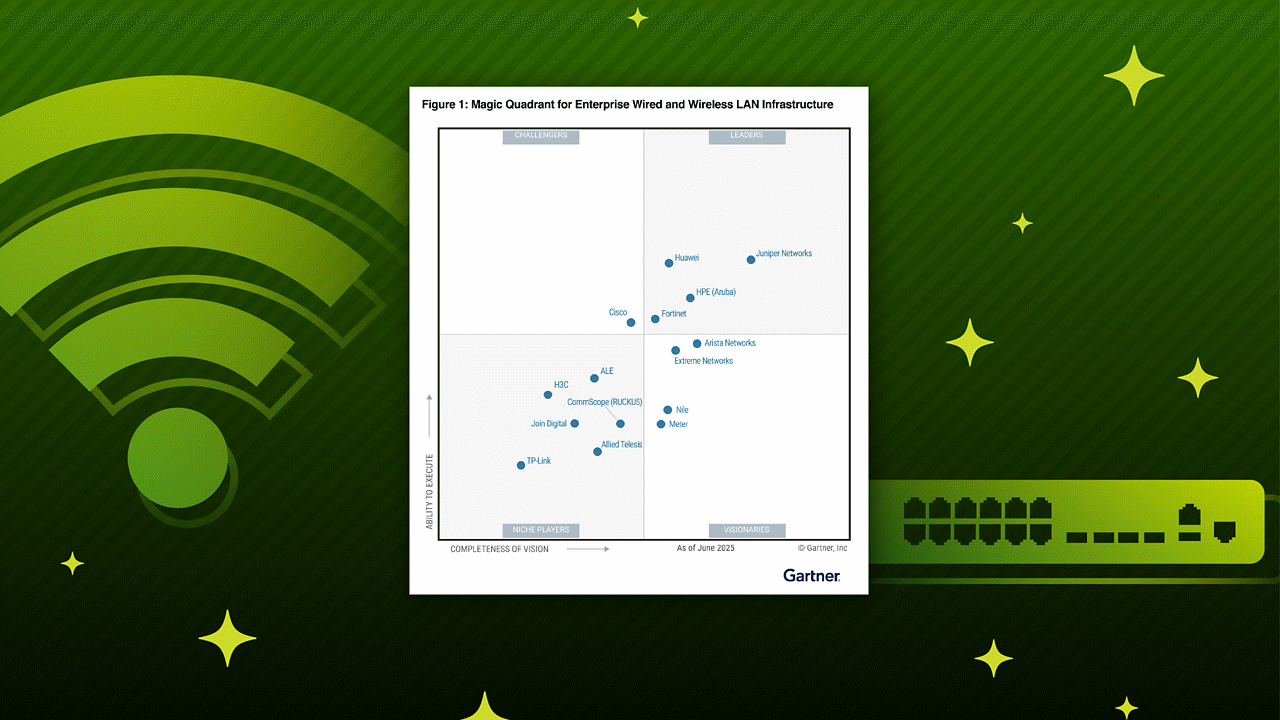

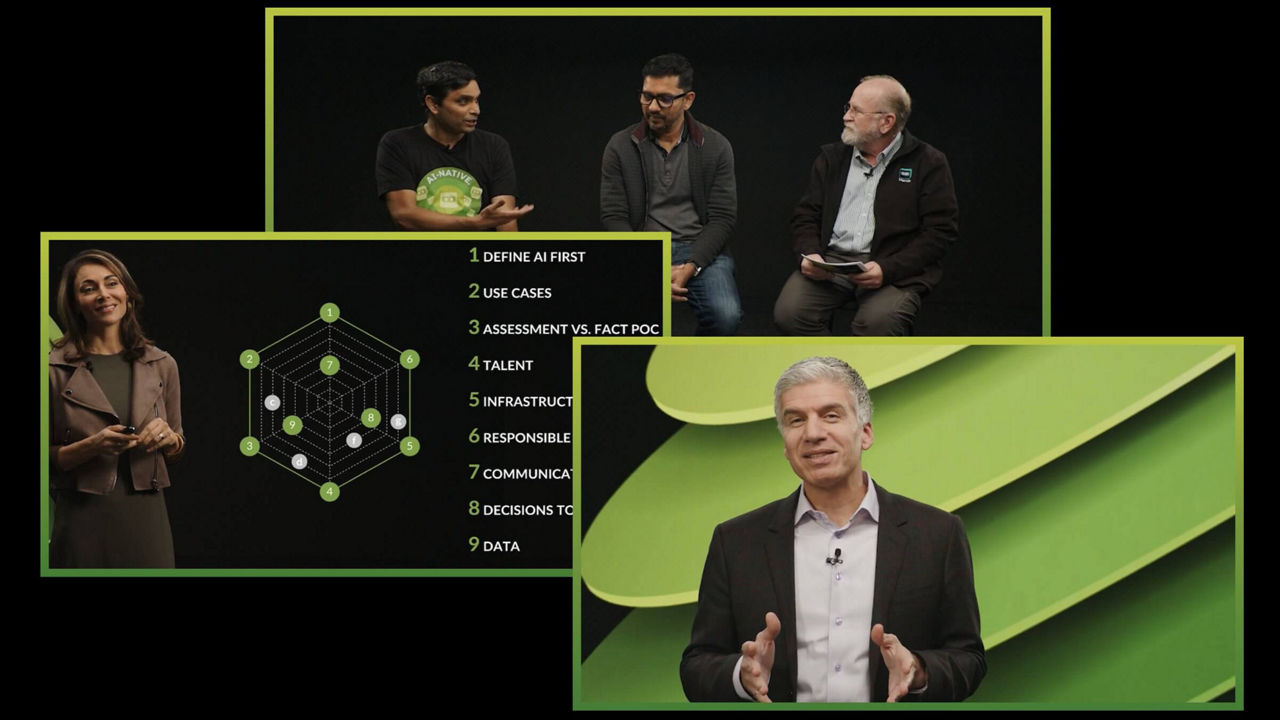

처음에는 퍼블릭 클라우드가 AI 기술의 혁신가와 얼리 어댑터에게 유일한 대안이었습니다. 퍼블릭 클라우드는 여전히 대부분의 AI 전략에서 중요한 부분이지만, 데이터 보안과 비용에 대한 우려로 프라이빗 데이터센터와 하이브리드 클라우드 아키텍처가 대세로 떠오르고 있습니다. 주니퍼가 최근 개최한 가상 이벤트인 Seize the AI Moment에서 고객, 파트너, 업계 전문가들은 금융 기관의 데이터 보안 문제, 비용과 성능의 균형을 맞추기 위한 하이브리드 클라우드 사용 전략 등 각자의 하이브리드 클라우드 사용 사례와 전략에 대해 논의했습니다.

비용: 고비용의 AI 환경에서 ROI 극대화하기

구축 모델에 관계없이 AI를 구축하는 데 비용이 많이 든다는 것은 잘 알려진 사실입니다. AI의 비용은 예산, 전문성, 시간으로 측정되며, 모두 자원의 제약이 따르는 항목입니다. 전문 지식과 시간은 기업마다 고유한 가변 비용이지만, AI에 대한 막대한 투자는 시장이 주도하고 할당된 예산에 의해서만 결정됩니다.

GPU 서버당 약 40만 달러로, 소규모 AI 데이터센터의 인프라 비용만 수백만 달러에 달할 수 있습니다. 그러나 어느 정도 안심할 수 있습니다. PyTorch 2.0과 같은 AI 프레임워크는 NVIDIA 칩셋에 대한 긴밀한 통합과 종속성을 제거했습니다. 이로써 인텔, AMD 등의 경쟁력 있는 GPU 제품이 시장의 역학 관계를 뒤흔들고 비용을 정상화할 수 있는 기회가 열렸습니다.

현재 수준에서는 퍼블릭 클라우드 프로바이더에서 AI 서비스를 구매하는 것이 프라이빗 AI 데이터센터를 구축하는 것보다 비용 효과적일 것이라고 생각하기 쉽습니다. 하지만 최근 ACG Research의 총 소유 비용(TCO) 분석에 따르면 그렇지 않습니다. 프라이빗 AI 데이터센터의 3년 TCO와 유사한 퍼블릭 클라우드 호스팅 AI 서비스의 3년 TCO를 비교한 결과, 프라이빗 데이터센터 모델이 퍼블릭 클라우드 서비스와 관련된 높은 반복 비용으로 인해 46%의 TCO를 절감할 수 있는 것으로 나타났습니다.

ACG 보고서는 InfiniBand 네트워킹 비용과 이더넷 비용을 비교하여 AI 데이터센터 구축 비용을 추가로 분석했습니다. ACG는 조사 결과에서 RoCE v2 및 주니퍼 Apstra와 함께 주니퍼 이더넷을 구축하면 InfiniBand 네트워크에 비해 처음 3년 동안 56%의 OpEx 절감 및 55%의 CapEx 절감을 포함하여 55%의 TCO 절감 효과를 얻을 수 있음을 보여주었습니다.

결과적으로 AI 데이터센터 구축은 퍼블릭 클라우드의 프리미엄을 상쇄할 수 있는 비용 효과적인 옵션이며, 이더넷 기반 AI 패브릭을 구축하면 기존의 사내 전문성을 활용하여 빠른 구축을 통해 비용을 더욱 절감할 수 있습니다.

프라이빗 엔터프라이즈 및 하이브리드 AI 구축 간소화

애플리케이션 요구 사항, 구축 모델, 비용은 프라이빗 또는 하이브리드 클라우드 모델에 투자할 때 고려해야 할 중요한 사항입니다. 하지만 기업 혼자서 할 수 있는 일은 아닙니다. AI는 대부분의 기업에게 새로운 개념이며 AI 인프라는 복잡한 과제를 제시하지만, 현재 데이터센터 네트워킹 지식의 상당 부분이 적용될 수 있는 마법과 같은 것은 아닙니다. 주니퍼는 AI 기술에 투자하여 혁신을 주도하면서 AI에 도달하는 경로를 간소화했습니다. GPU 컴퓨팅, 고급 스토리지 플랫폼 및 QFX 시리즈 스위치의 레일 최적화된 주니퍼 이더넷 패브릭, PTX 시리즈 라우터, 주니퍼 Apstra 네트워크 자동화의 멀티벤더 아키텍처를 사용하는 주니퍼의 Ops4AI Lab은 기업이 구축하기 전에 맞춤형 AI 클러스터 설계를 검증할 수 있도록 공개되어 있습니다. AI 혁신 랩은 오픈 소스와 BYOM(Bring Your Own Models)을 모두 사용하여 고객이 불확실성을 제거할 수 있도록 지원합니다.

주니퍼의 Ops4AI Lab

주니퍼의 Ops4AI Lab은 사전 검증된 멀티벤더 AI 데이터센터의 주니퍼 검증 설계(JVD) 파이프라인을 구동하는 엔진이기도 합니다. 기업은 JVD를 통해 지원되는 컴퓨팅 및 스토리지 인프라를 주니퍼의 고급 AI 데이터센터 설계와 믹스 앤 매치하여 추측을 배제하고 복잡한 설계 및 구축을 간소화할 수 있습니다.

주니퍼 Apstra 네트워크 자동화를 사용하여 기업은 맞춤형 구축에 사용할 청사진을 설계하거나 주니퍼의 Terraform 프로바이더를 사용하여 백엔드 컴퓨팅, 백엔드 스토리지, 프론트엔드 관리를 위해 GitLab에서 호스팅하는 AI 청사진을 다운로드할 수 있습니다.

주니퍼의 Ops4AI Lab, 고객 AI 사용 사례, NVIDIA, AMD, WEKA, Intel 등을 포함한 주니퍼의 AI 파트너 에코시스템에 대해 자세히 알아보려면 주니퍼의 AI 가상 이벤트인 ‘Seize the AI Moment’ 다시 보기를 시청하거나 이 링크를 따라 AI 데이터센터 랜딩 페이지로 이동하십시오.